La actriz de Resident Evil construyó la IA de memoria más potente del mundo: los devs dicen que los números no cuadran

MemPalace llegó el 6 de abril con 23 mil estrellas en 48 horas, benchmarks perfectos y el nombre de Milla Jovovich. La comunidad ya encontró los trucos detrás de los números, pero la herramienta igual puede valer la pena.

Hay lanzamientos que se vuelven virales por la tech. Hay otros que se vuelven virales por el nombre. MemPalace fue las dos cosas al mismo tiempo, y ninguna de las dos formas de leerlo es completamente correcta.

El 6 de abril de 2026, Ben Sigman, CEO de Libre Labs, y Milla Jovovich, sí, la actriz de Resident Evil y The Fifth Element, publicaron MemPalace en GitHub con una promesa bastante ambiciosa: el sistema de memoria para IA con el puntaje más alto jamás benchmarkeado. MIT license, gratis, corre local, sin API keys. En menos de 48 horas ya tenía más de 23 mil estrellas y 1.5 millones de vistas en Twitter. La comunidad dev no tardó en ponerse a revisar los números, y lo que encontraron es la historia de siempre: marketing exagerado sobre una herramienta que igual tiene valor real.

Qué es MemPalace y cómo funciona

La idea central viene de un truco mnemónico que existe desde los griegos: el “método de loci” o palacio de la memoria. En vez de dejar que la IA decida qué recordar, MemPalace guarda todo en una estructura navegable. Las conversaciones se organizan en wings (personas o proyectos), halls (tipos de memoria) y rooms (ideas específicas). Si quieres que tu agente de IA recuerde que prefieres respuestas en español y que trabajas con Python, eso queda guardado en un cuarto concreto, no flotando en un embedding que puede o no recuperarse.

El stack técnico es lo que le da valor para devs que quieren cero costos: ChromaDB para el vector store, SQLite para el grafo temporal y PyYAML para serialización. Todo corre local, compatible con Llama, Mistral y cualquier modelo que ya tengas corriendo en tu máquina. Si ya seguiste nuestra guía para correr tu propia IA local con Ollama y LM Studio, MemPalace encaja directo en ese setup.

La motivación de Jovovich, según sus propias palabras, fue que los sistemas de memoria existentes dejaban que la IA decidiera qué era importante. Ella quería controlar eso. Razonable. El problema vino con cómo vendieron los números.

Los benchmarks que no cuadran

El README original proclamaba 100% en LongMemEval y 100% en LoCoMo, describiendo a MemPalace como “el sistema de memoria para IA con el puntaje más alto jamás benchmarkeado”. Penfield Labs analizó la metodología y encontró varios problemas que vale la pena entender:

El truco del top_k=50. El runner de LoCoMo usa top_k=50 para recuperar sesiones candidatas, pero cada conversación en el dataset tiene solo 19 a 32 sesiones en total. Si pides 50 candidatos de un pool de 25, el resultado correcto siempre va a estar en los candidatos, sin importar qué tan bien o mal funcione el embedding. No es una prueba de retrieval, es literalmente tirar toda la información dentro de Claude Sonnet y preguntarle cuál coincide. El puntaje honesto sin ese truco es 60.3% R@10 sin reranking y 88.9% con reranking híbrido, no 100%.

El error de categoría en LongMemEval. El benchmark real de LongMemEval mide el pipeline completo: recuperar, generar una respuesta, y que un juez GPT-4 diga si estuvo bien. El runner de MemPalace solo verifica si el ID de sesión correcta aparece en los primeros 5 resultados, lo cual es una métrica diferente e incomparable con la tabla oficial. El propio BENCHMARKS.md del repositorio lo admite, pero el marketing exterior no lo menciona.

Teaching to the test. El 100% en LongMemEval se logró identificando los 3 casos que fallaban y escribiendo parches específicos para esos casos, luego corriendo el mismo set de 500 preguntas de nuevo. El BENCHMARKS.md original incluso tiene una sección de integridad que dice explícitamente que no hagan eso. Lo hicieron igual. Un community note en el tweet de lanzamiento de Ben Sigman ya lo señala.

La detección de contradicciones que no existe. El marketing habla de que MemPalace “detecta contradicciones: nombres incorrectos, pronombres incorrectos, edades incorrectas”. El archivo knowledge_graph.py no tiene ni una sola mención de “contradict”. Lo que existe es deduplicación por coincidencia exacta de tripletas sujeto-predicado-objeto. Si guardas dos hechos contradictorios con diferente wording, ambos quedan.

Los números honestos, que igual son buenos

Todo lo anterior suena muy mal, pero hay que ser justos: los números reales de MemPalace siguen siendo competitivos frente a las alternativas de pago.

| Métrica | MemPalace (real) | Mem0 / Zep (aprox.) |

|---|---|---|

| LongMemEval raw (sin LLM) | 96.6% R@5 | ~85% |

| LoCoMo híbrido (sin LLM) | 88.9% R@10 | ~85% |

| Costo mensual | $0 | $19 a $249 |

La mejora del 34% frente a búsqueda semántica plana es real y verificada de forma independiente. El 96.6% en modo raw (sin reranking con LLM, sin API keys) fue confirmado por un miembro de la comunidad en GitHub Issue #39 corriendo en M2 Ultra. Eso no es poca cosa. Mem0 en su tier de entrada cobra $19 al mes y su funcionalidad de grafo está gateada hasta los $249 mensuales. Zep cobra $25 desde el arranque.

Para un dev mexicano independiente o una startup pequeña, la diferencia entre $0 y $249 al mes es dinero real. Y si tu setup ya incluye un modelo local, el costo de operación de MemPalace baja a prácticamente cero.

¿Milla Jovovich realmente codea?

La pregunta que todos se hicieron cuando vieron el nombre del repositorio. La respuesta honesta es: parcialmente. Ben Sigman construyó la mayoría del código, usando Claude Code como herramienta principal de desarrollo. Jovovich tenía 7 commits y 2 días de historial en GitHub al momento del lanzamiento.

Eso no significa que su contribución sea cero. Ella diseñó la arquitectura conceptual, el sistema de wings/halls/rooms, la filosofía de “guardar todo en vez de dejar que la IA filtre”. La motivación original y el marco estructural son suyos. Sigman lo dice sin rodeos: “De día está filmando películas de acción, desfilando para Miu Miu y siendo mamá. De noche codea.”

¿Es el framing un poco agresivo para aprovechar un nombre famoso y conseguir atención? Sí, claramente. ¿Invalida la herramienta? No necesariamente. Lo mismo aplica para los benchmarks: el marketing fue exagerado, pero la herramienta tiene valor real debajo del ruido.

El fenómeno no es nuevo en IA, como comentamos en nuestra comparativa de herramientas de IA para programar en 2026: la brecha entre lo que se anuncia y lo que el producto entrega es gigante en este ecosistema. Hay que saber leer los números.

¿Vale la pena instalarlo?

Para devs mexicanos que ya tienen un setup de IA local, la respuesta es sí, con expectativas calibradas. No es el sistema de memoria más poderoso del mundo. Los benchmarks de 100% son puro marketing. Pero el 96.6% raw real, la arquitectura de palacio que sí organiza mejor la memoria que una búsqueda semántica plana, y sobre todo el precio de $0 con licencia MIT, hacen que valga la prueba.

El equipo está respondiendo activos en issues y mergeando PRs rápido. En los primeros días ya había más de 50 pull requests de la comunidad. Si la trayectoria se mantiene, puede convertirse en algo sólido.

La tech está ahí. Los benchmarks son trucho. Instálalo sabiendo eso.

Si quieres probarlo, el repositorio está en github.com/milla-jovovich/mempalace y la documentación oficial con los benchmarks (la versión honesta, enterrada en 5,000 palabras de BENCHMARKS.md) está en mempalace.tech/benchmarks.

¿Ya lo corriste? ¿Cómo te fue comparado con Mem0 o con tu setup actual? Cuéntanos en los comentarios.

Fuentes

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

Gemma 4: Google lanzó el modelo de IA que corre offline en tu celular y ya aplasta a modelos 10 veces más grandes

Google liberó Gemma 4 el 2 de abril bajo licencia Apache 2.0 pura: corre en tu smartphone sin internet, soporta 256K tokens de contexto y el 31B supera en benchmarks a modelos 20 veces más grandes. Esto cambia todo para devs en México y LATAM.

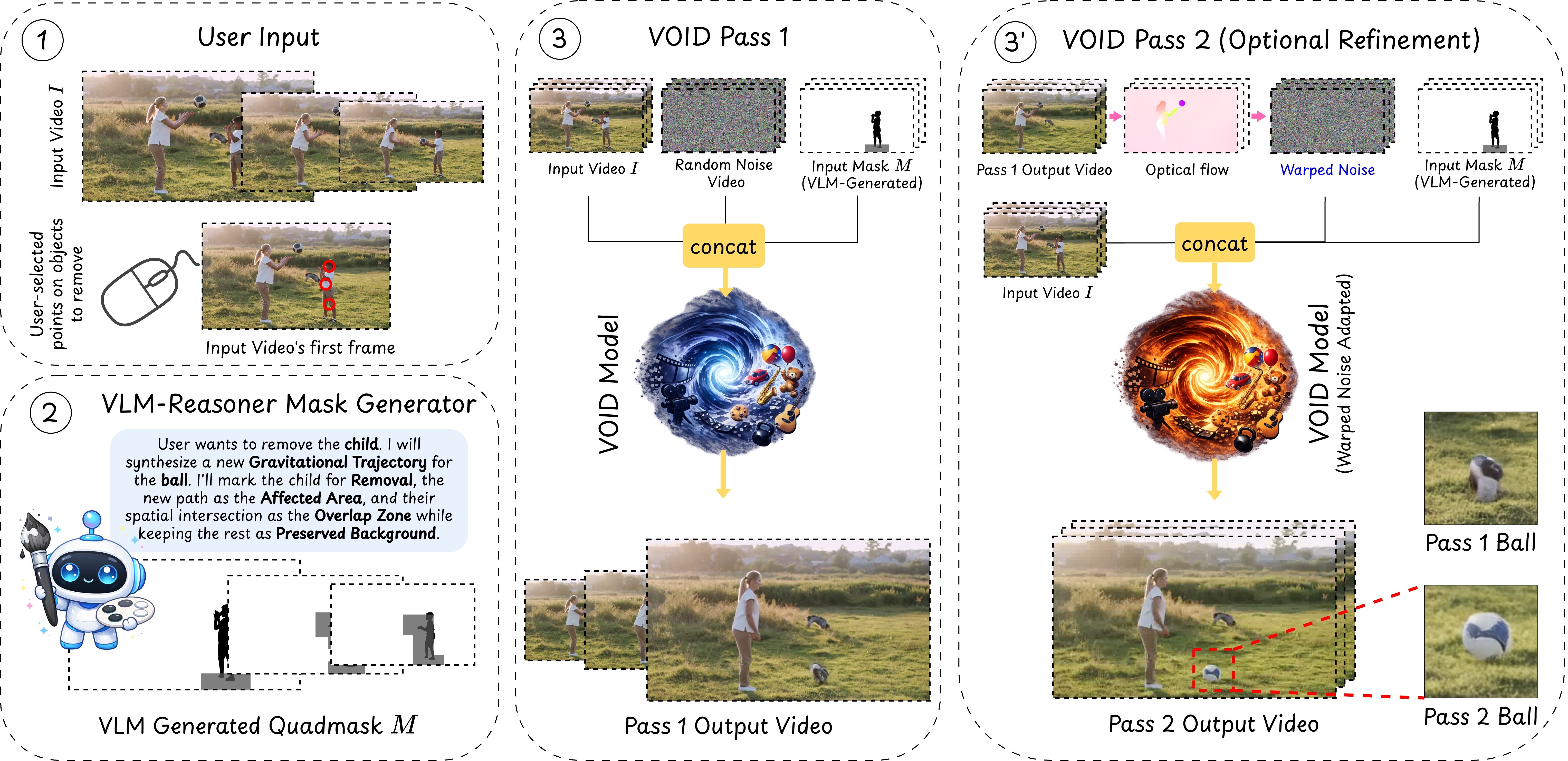

Netflix open-sourceó VOID: borra objetos de tus videos con IA gratis y sin suscripción (guía para usarlo hoy)

VOID es el primer modelo de IA público de Netflix: elimina objetos de video y reconstruye la física del entorno como si nunca hubieran existido. Apache 2.0, gratis, sin cuenta, disponible ya en Hugging Face.

DeepSeek V4 llega en semanas: 1 trillón de parámetros, Apache 2.0 y casi 54 veces más barato que Claude Opus

The Information confirmó el 3 de abril que DeepSeek V4 es inminente. Lo que necesitan saber los devs y startups en México sobre el modelo chino que iguala benchmarks frontier a costo de tianguis.