Netflix open-sourceó VOID: borra objetos de tus videos con IA gratis y sin suscripción (guía para usarlo hoy)

VOID es el primer modelo de IA público de Netflix: elimina objetos de video y reconstruye la física del entorno como si nunca hubieran existido. Apache 2.0, gratis, sin cuenta, disponible ya en Hugging Face.

Netflix lleva años siendo uno de los mayores consumidores de efectos visuales del planeta. Cientos de millones de dólares en VFX por temporada, estudios de post-producción trabajando 24/7 para que nada se vea raro en pantalla. Y resulta que, en silencio, estaban construyendo su propia herramienta de IA para borrar objetos de video.

El 3 de abril la soltaron al público. Gratis. Con licencia Apache 2.0. Sin cuenta, sin suscripción, sin tarjeta de crédito.

Se llama VOID y es el primer modelo de IA que Netflix open-sourcetea en su historia.

Qué hace VOID exactamente (y por qué no es lo mismo de siempre)

VOID significa Video Object and Interaction Deletion. El nombre ya te dice bastante, pero el detalle que lo hace diferente está en la última palabra: Interaction.

Las herramientas de eliminación de objetos que ya conoces, ya sea Runway, After Effects content-aware fill, o lo que sea, hacen básicamente lo mismo: borran el objeto y rellenan el hueco con el fondo reconstruido. Funciona bien si el objeto estaba quieto y no tocaba nada. Pero si estaba interactuando con el entorno, el resultado queda raro porque la herramienta ignora la física.

VOID lo resuelve diferente. Si borras a una persona que estaba jalando una silla, la silla queda en su lugar como si nunca se hubiera movido. Si eliminas un auto que chocó contra otro, el segundo auto sigue su trayectoria como si el primero nunca hubiera existido. Si quitas a alguien que cayó a una alberca, el agua queda quieta.

El modelo entiende qué estaba causando el objeto eliminado y reconstruye la escena de forma físicamente coherente. Eso es lo que no hacía ninguna herramienta antes.

Cómo funciona por dentro

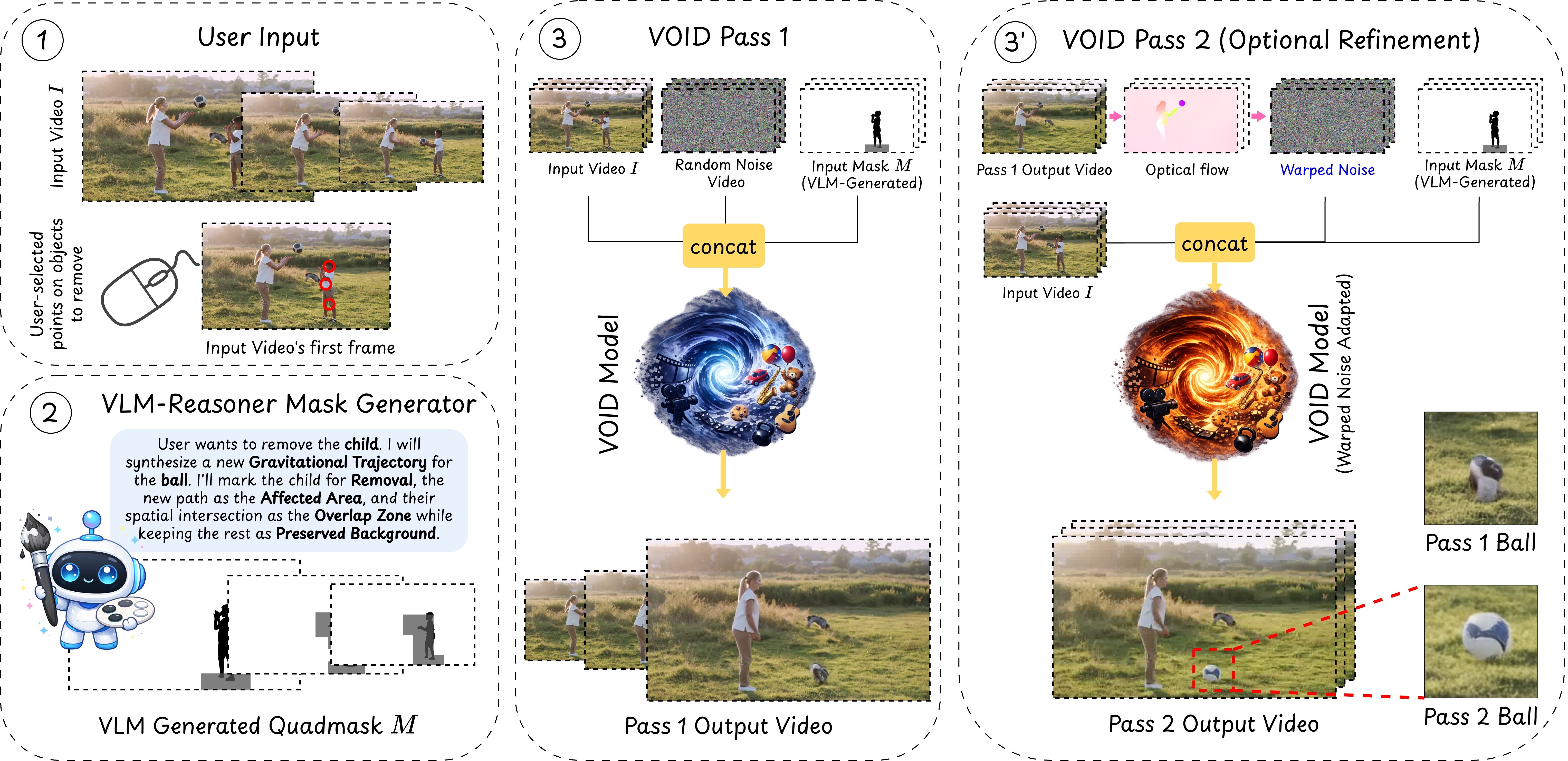

VOID es un pipeline de varios modelos especializados trabajando en cadena:

Google Gemini 3 Pro analiza el video y detecta qué regiones del entorno están siendo causalmente afectadas por el objeto que vas a borrar.

Meta SAM2 segmenta el objeto con precisión frame por frame.

CogVideoX (un modelo de difusión de video de 5 mil millones de parámetros de Alibaba, ajustado por Netflix) genera el video reconstruido con la física correcta.

La innovación técnica se llama quadmask: en vez de una máscara binaria de “borrar/conservar”, VOID usa una máscara de 4 valores que le dice al modelo qué parte es el objeto a eliminar, qué está siendo ocultado por él, qué está siendo físicamente afectado, y qué debe quedar intacto. Eso le da suficiente contexto para generar algo coherente.

Opcionalmente hay un segundo pase de refinamiento para estabilizar artefactos temporales y que la reconstrucción no tiemble entre frames.

Cómo usarlo hoy sin tener una A100

Los requisitos locales son considerables: 40GB de VRAM, o sea una NVIDIA A100. Nada que tengas en casa a menos que seas un data center ambulante.

Pero hay dos formas de usarlo sin hardware de ese nivel:

Demo en Hugging Face Spaces: El demo de VOID corre directo en el navegador, sin instalar nada, sin cuenta. Subes tu video, defines la máscara, y el modelo corre en los servidores de Hugging Face. Perfecto para probar y para proyectos pequeños.

Google Colab: Si quieres más control sin pagar por hardware propio, hay un notebook de Colab oficial en el GitHub de Netflix que te permite correrlo en GPUs de Google. Con el plan gratuito de Colab puedes hacer cosas simples; con Colab Pro (~200 pesos al mes) tienes acceso a GPUs más potentes y mayor tiempo de cómputo.

Si sí tienes el hardware o acceso a un servidor, el modelo completo está en Hugging Face y en GitHub bajo Apache 2.0, lo que significa que puedes usarlo comercialmente sin pagar regalías a nadie.

Qué tan bueno es comparado con Runway

Netflix hizo un estudio de preferencia humana con 25 participantes probando múltiples escenarios. Los resultados:

| Modelo | Preferencia |

|---|---|

| VOID | 64.8% |

| Runway | 18.4% |

| Resto (ProPainter, DiffuEraser, ROSE, MiniMax-Remover) | lo que queda |

Runway gana 18.4% de las veces. VOID gana 64.8%. Es una diferencia brutal, especialmente considerando que Runway cobra sus planes más serios en dólares y esto es gratis.

Vale aclarar que los estudios de preferencia humana tienen sus limitaciones y Netflix los hizo ellos mismos, así que hay que tomarlo con calma. Pero incluso con ese descuento, los ejemplos que muestran en la página del proyecto VOID son notablemente convincentes.

Para qué le sirve esto a los creadores en México

Si haces contenido de video, la lista de casos de uso es larga:

Para youtubers y streamers: borrar objetos del fondo que arruinan la continuidad entre tomas. Un ventilador, un objeto que se cayó sin que te dieras cuenta, cables visibles.

Para videógrafos de bodas o eventos: remover personas o cosas del plano que no deberían estar ahí sin tener que pedir que se muevan o regrabar la escena.

Para productoras pequeñas: esto es lo que pagaban fortunas en VFX antes. Si tienen una escena donde alguien toca algo y luego hay que cortar esa persona, antes tenías que regresar al set o asumir el costo de vfx artesanales. VOID lo automatiza.

Para creadores de contenido educativo o corporativo: los booms de micrófono que entran al cuadro, el crew que aparece reflejado en una pantalla, logos de marcas en ropa que hay que quitar por derechos.

Como explicamos cuando cubrimos cómo correr tu propia IA local en 2026 con Ollama y LM Studio, el tendencia de democratizar herramientas de producción que antes eran exclusivas de estudios con presupuesto está acelerando. VOID es otro paso en esa dirección, pero específicamente para video profesional.

La parte técnica si quieres instalarlo tú mismo

pip install -r requirements.txt

# Baja el modelo base de CogVideoX

huggingface-cli download alibaba-pai/CogVideoX-Fun-V1.5-5b-InP \

--local-dir ./CogVideoX-Fun-V1.5-5b-InP

# Baja los pesos de VOID

huggingface-cli download netflix/void-model \

--local-dir .La estructura de input que necesitas preparar es:

mi-video/

input_video.mp4 # el video original

quadmask_0.mp4 # video de máscara en 4 valores

prompt.json # {"bg": "descripción del fondo después de la eliminación"}La parte más trabajosa es generar la quadmask correctamente. El demo de Hugging Face lo hace de forma más sencilla con herramientas de pincel integradas.

Lo que no hace (y hay que decirlo)

VOID no es magia. Funciona mejor en secuencias cortas (máximo 197 frames por defecto, o sea menos de 7 segundos a 30fps). Para proyectos largos necesitas procesarlo en segmentos. La calidad también depende de qué tan bien definas la máscara: una máscara floja produce resultados mediocres.

Tampoco es instantáneo. El tiempo de procesamiento depende del hardware, y en Colab gratuito puedes esperar varios minutos por clip.

Y sí, está una chimba para remover objetos estáticos o con movimiento simple, pero escenas con interacciones muy complejas o iluminación dinámica intensa todavía presentan artefactos. Es una beta académica, no un plugin de Premiere terminado.

Por qué esto importa más allá de la herramienta en sí

Netflix tiene acceso a décadas de contenido audiovisual y a algunos de los mejores ingenieros de visión por computadora del mundo. El hecho de que decidan open-sourcetear su primera herramienta con Apache 2.0, que es la licencia más permisiva que existe para uso comercial, dice algo sobre hacia dónde están pensando. La apuesta parece ser que generar goodwill en la comunidad de investigación y ayudar a establecer estándares les beneficia más que guardar la herramienta solo para ellos.

Similar a lo que vimos con el debate del modelo open source de OpenAI que llegó después de 7 años: las empresas grandes están entendiendo que el open source estratégico no es filantropía, es posicionamiento.

Para los creadores en México, la conclusión es simple: tienes una herramienta de nivel profesional disponible hoy, gratis, en el navegador. Vale la pena probarla aunque sea por curiosidad.

¿Ya la probaron? ¿La están usando para algo específico? Cuenten en los comentarios.

Fuentes

- Netflix/void-model en GitHub (Apache 2.0)

- Modelo VOID en Hugging Face

- Demo interactivo en Hugging Face Spaces

- MarkTechPost: Netflix AI Team Just Open-Sourced VOID

- The Decoder: Netflix open-sources VOID

- The Register: Now even Netflix has its own video AI

- Página oficial del proyecto VOID

- Preprint arXiv 2604.02296

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

Gemma 4: Google lanzó el modelo de IA que corre offline en tu celular y ya aplasta a modelos 10 veces más grandes

Google liberó Gemma 4 el 2 de abril bajo licencia Apache 2.0 pura: corre en tu smartphone sin internet, soporta 256K tokens de contexto y el 31B supera en benchmarks a modelos 20 veces más grandes. Esto cambia todo para devs en México y LATAM.

La actriz de Resident Evil construyó la IA de memoria más potente del mundo: los devs dicen que los números no cuadran

MemPalace llegó el 6 de abril con 23 mil estrellas en 48 horas, benchmarks perfectos y el nombre de Milla Jovovich. La comunidad ya encontró los trucos detrás de los números, pero la herramienta igual puede valer la pena.

DeepSeek V4 llega en semanas: 1 trillón de parámetros, Apache 2.0 y casi 54 veces más barato que Claude Opus

The Information confirmó el 3 de abril que DeepSeek V4 es inminente. Lo que necesitan saber los devs y startups en México sobre el modelo chino que iguala benchmarks frontier a costo de tianguis.