Anthropic vs. el Pentágono: la empresa de IA que le dijo NO a las armas autónomas

Anthropic, los creadores de Claude, se negaron a dar su IA al Pentágono para armas autónomas y vigilancia masiva. El gobierno los declaró 'riesgo de cadena de suministro'. Anthropic demandó. Esta es la pelea que define el futuro de la IA.

Imagina que construyes una herramienta increíblemente poderosa. El gobierno más poderoso del mundo te dice: “Danos acceso total, sin restricciones”. Tú dices que no. Entonces te declaran enemigo del estado.

Eso es, básicamente, lo que está pasando entre Anthropic (la empresa que creó Claude, la IA que probablemente algunos de ustedes ya usan) y el Pentágono de Estados Unidos. Y esta historia tiene de todo: ética, poder, demandas legales, traiciones entre rivales tech, y el futuro de la inteligencia artificial en juego.

Vamos al chile.

El contexto: ¿Quién es Anthropic?

Anthropic es la empresa detrás de Claude, uno de los modelos de IA más avanzados del mundo. Fue fundada por Dario y Daniela Amodei, exempleados de OpenAI que se fueron precisamente porque sentían que OpenAI no se tomaba la seguridad en serio.

Desde el día uno, Anthropic se posicionó como la empresa de IA “responsable”. Su pitch siempre fue: “Vamos a construir la IA más capaz posible, pero con líneas rojas que no cruzaremos”.

Esas líneas rojas son dos:

- No a las armas autónomas: sin supervisión humana en la cadena de decisión letal

- No a la vigilancia masiva de ciudadanos

Suena razonable, ¿no? Bueno, al Pentágono no le pareció.

La escalada: de petición a amenaza

Febrero 2026: El ultimátum

El Secretario de Defensa Pete Hegseth le dio a Dario Amodei un deadline: permitir el “uso irrestricto para todos los propósitos legales” de la tecnología de Anthropic. En otras palabras: danos Claude sin condiciones.

Amodei dijo que no.

“Las amenazas del Pentágono no cambian nuestra posición”, declaró públicamente el 26 de febrero. Anthropic rechazó la oferta, diciendo: “No podemos en buena conciencia acceder a su petición”.

27 de febrero: La represalia

La respuesta del gobierno fue brutal:

- Trump ordenó que todas las agencias federales dejaran de usar productos de Anthropic

- El Pentágono designó a Anthropic como “riesgo de cadena de suministro”, una etiqueta que antes solo se usaba para empresas de países adversarios como Huawei (China)

- OpenAI (el rival directo de Anthropic) inmediatamente anunció un acuerdo con el Pentágono. Timing conveniente, ¿no?

De un día para otro, Anthropic pasó de ser una empresa tech respetada a ser tratada como si fuera una amenaza para la seguridad nacional. Todo por negarse a dar acceso sin restricciones a su IA.

Amodei vs. Altman: el drama entre rivales

Aquí se puso personal.

El 4 de marzo se filtró un memo interno de Dario Amodei donde calificaba la comunicación de OpenAI sobre su acuerdo con el Pentágono como “mentiras directas” (straight up lies). Acusó a Sam Altman de “presentarse como pacificador y negociador” cuando en realidad estaba aprovechándose de la situación.

Textual: “La razón principal por la que ellos aceptaron y nosotros no es que a ellos les importó apaciguar a sus empleados, y a nosotros nos importó realmente prevenir abusos”.

También se filtró que llamó a empleados de OpenAI “crédulos” (gullible). Después se disculpó por eso. Pero el daño ya estaba hecho. La rivalidad Anthropic-OpenAI ya no es solo de producto, es ideológica.

La demanda: Anthropic contraataca

El 9 de marzo, Anthropic hizo algo que ninguna empresa de IA había hecho: demandó al gobierno federal de Estados Unidos.

Presentó dos demandas simultáneas:

- Una en el Tribunal del Distrito Norte de California

- Otra en la Corte de Apelaciones de D.C.

Los argumentos legales:

- Violación de la Primera Enmienda: La designación de “riesgo de cadena de suministro” fue retaliación por ejercer su libertad de expresión al rechazar los términos del Pentágono

- Exceso de autoridad gubernamental: El gobierno usó una designación de seguridad nacional como herramienta de presión comercial, no por razones legítimas de seguridad

Amodei lo resumió así: “Estar en desacuerdo con el gobierno es lo más americano del mundo. Y somos patriotas. En todo lo que hemos hecho aquí, hemos defendido los valores de este país”.

La industria tech toma partido

Lo que pasó después es lo más interesante: la industria tech se alineó detrás de Anthropic.

- 30+ empleados de OpenAI y Google DeepMind (incluyendo a Jeff Dean, científico en jefe de Google) presentaron un amicus brief apoyando a Anthropic

- Microsoft presentó su propio amicus brief en favor de Anthropic

- Grupos de la industria argumentaron que si el gobierno puede blacklistear a una empresa por desacuerdos éticos, “todo el sistema de contratación se vuelve contingente a favores políticos en vez del estado de derecho”

Incluso competidores de Anthropic entienden que si esto le pasa a Anthropic hoy, le puede pasar a cualquiera mañana.

El impacto económico

Anthropic le advirtió al juez que la prohibición podría costarle miles de millones de dólares. Clientes empresariales ya estaban acortando o cancelando contratos por la incertidumbre.

La audiencia para decidir si Anthropic recibe protección temporal está programada para el 24 de marzo (la próxima semana).

¿Por qué nos importa esto en México y Latinoamérica?

Podrías pensar: “Esto es un pedo gringo, ¿a mí qué?”. Pero no.

1. La IA que usas podría cambiar

Si Anthropic pierde esta batalla, las empresas de IA que se nieguen a cooperar con gobiernos podrían ser castigadas económicamente. ¿El resultado? Solo sobreviven las que digan que sí a todo. Y eso significa IA sin restricciones éticas en manos de gobiernos.

2. El precedente para todo el mundo

Si Estados Unidos puede obligar a empresas de IA a cooperar sin límites, otros gobiernos harán lo mismo. China ya lo hace. ¿Rusia? ¿Brasil? ¿México? El precedente que se establezca aquí define las reglas para todos.

3. La IA como herramienta de vigilancia

Una de las líneas rojas de Anthropic es la vigilancia masiva. En Latinoamérica, donde los gobiernos ya han usado herramientas como Pegasus para espiar periodistas y activistas, la pregunta de quién controla la IA y con qué límites es urgente.

4. La economía de la IA

México está creciendo como hub tech. Empresas mexicanas usan Claude, GPT, y otros modelos de IA. Si la geopolítica de la IA se vuelve un campo minado, las empresas latam quedan atrapadas en medio.

OpenAI vs. Anthropic: dos visiones del futuro

Esta pelea cristaliza la diferencia fundamental entre las dos empresas de IA más importantes del mundo:

OpenAI (Sam Altman): Pragmatismo. Cooperar con el gobierno, crecer rápido, dominar el mercado. La lógica es: “Es mejor que estemos nosotros en la mesa a que nos reemplacen con algo peor”.

Anthropic (Dario Amodei): Principios. Hay líneas que no se cruzan, sin importar el costo. La lógica es: “Si normalizamos el uso irrestricto de IA por gobiernos, no hay vuelta atrás”.

¿Quién tiene razón? Depende de tu perspectiva. El pragmatismo de OpenAI tiene lógica si crees que la IA militar es inevitable y es mejor tener una voz en la mesa. La postura de Anthropic tiene lógica si crees que hay usos de la IA que simplemente no deberían existir.

Lo que es innegable es que Anthropic está poniendo su dinero (literalmente, miles de millones en riesgo) donde está su boca. Eso merece respeto, estés de acuerdo o no.

Lo que viene

La audiencia del 24 de marzo será crucial. Si el juez otorga protección temporal a Anthropic, la empresa gana tiempo y legitimidad. Si no, la presión económica podría ser insostenible.

Mientras tanto, la industria tech observa con nervios. Porque esta no es solo la historia de una empresa contra un gobierno. Es la historia que define quién controla la IA más poderosa del mundo, y con qué reglas.

Como dijo Amodei: “Creemos que cruzar esas líneas es contrario a los valores americanos, y quisimos defender esos valores”.

Sea cual sea el resultado, esta pelea ya cambió la conversación. Y eso, al chile, importa.

La próxima semana cubriremos el resultado de la audiencia. Mientras tanto, ¿tú qué opinas? ¿Anthropic tiene razón en negarse, o deberían cooperar? Déjanos tu comentario.

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

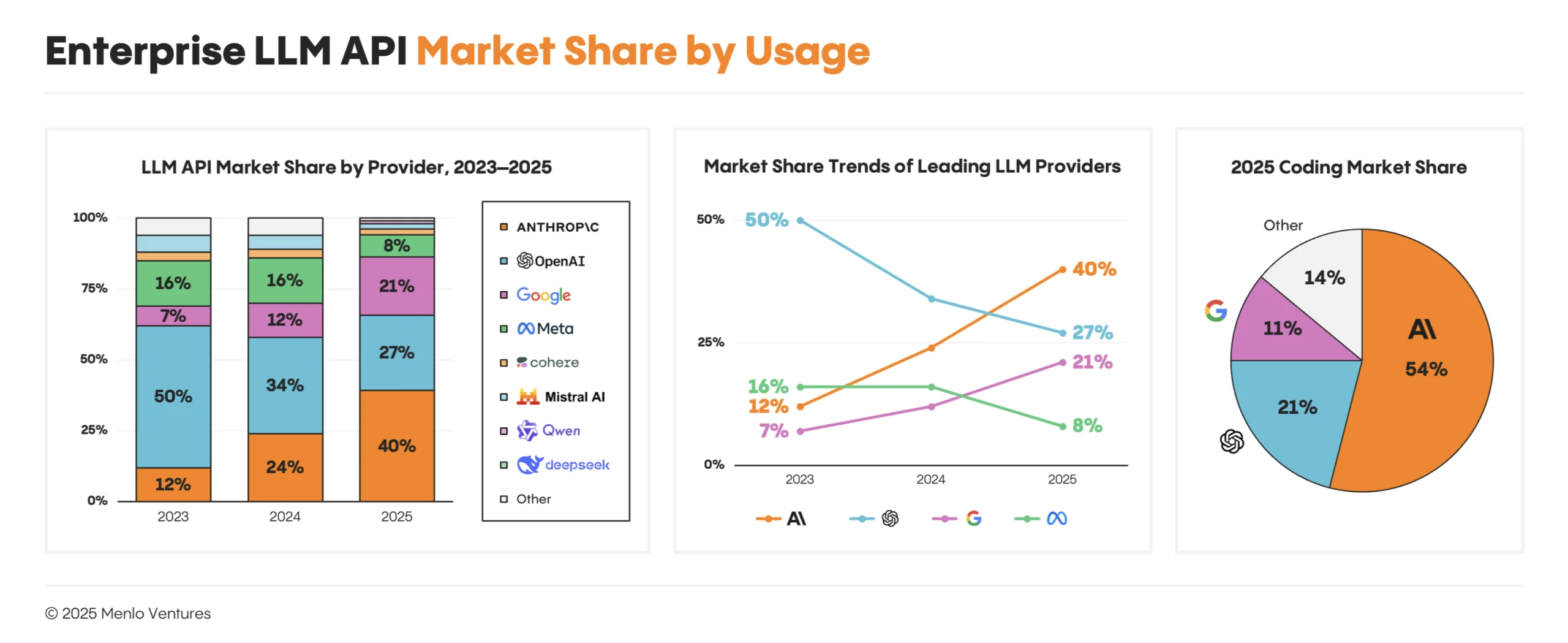

Anthropic le quitó el trono enterprise a OpenAI: del 12% al 40% en 2 años y qué cambia para empresas en México

Anthropic ya controla el 40% del mercado enterprise de IA mientras OpenAI cayó de 50% a 27%. Los datos del reporte más citado de 2025 y lo que deben hacer las empresas mexicanas con su stack.

Anthropic filtró sin querer 'Claude Mythos': el modelo de IA que aterró a las bolsas de ciberseguridad

Un error de configuración en el CMS de Anthropic expuso ~3,000 assets internos y reveló su modelo más poderoso: Capybara, por encima de Opus, con capacidades de ciberseguridad que hacen temblar a CrowdStrike y SentinelOne.

Claude sacó su propio OpenClaw: ahora mandas tareas desde el celular y tu PC las ejecuta

Anthropic lanzó Dispatch para Claude Cowork, una función que te deja controlar tu escritorio desde el teléfono. Así le responde a OpenClaw, pero con sandbox y sin los pedos de seguridad.