Nvidia GB300 Blackwell Ultra ya llega a clientes: cómo el hardware de $275K va a bajar lo que tu empresa paga por IA en la nube

El GB300 NVL72 ya se está entregando y promete 35x menos costo por token vs Hopper. Te explicamos qué significa esto para las empresas mexicanas que corren LLMs en AWS, Azure y GCP.

Hay un rack de servidores que cuesta más que una casa en Polanco, y aunque tú nunca lo vas a tener en tu cuarto, lo que está pasando con él va a cambiar cuánto pagan las empresas mexicanas por usar IA en la nube durante lo que queda de 2026.

El GB300 NVL72 de Nvidia ya se está entregando. No es un rumor ni un anuncio de CES. Las primeras unidades llegaron a clientes a principios de este año, DGX GB300 Station comenzó a enviarse a compradores en marzo, y CoreWeave y Azure ya tienen clusters a escala corriendo en producción. Y el impacto en precios de inferencia va a ser muy real para cualquier empresa, startup o dev en México que pague por llamadas a API de OpenAI, Anthropic o Google.

Qué diablos es el GB300 NVL72 (versión sin marketing)

El GB300 NVL72 es el sucesor del GB200, que ya era una bestia. La configuración NVL72 mete 72 GPUs Blackwell Ultra y 36 CPUs Nvidia Grace en un solo rack refrigerado por líquido. El resultado: 37 terabytes de memoria total, 130 terabytes por segundo de ancho de banda vía NVLink de quinta generación, y 15 PFLOPS de rendimiento FP4.

Sobre su antecesor directo, Nvidia reporta mejoras de 1.5x en FLOPS FP4, 2x en rendimiento de attention (lo que mueve modelos grandes con contextos largos), y 50x más throughput por megawatt versus la generación Hopper (que es el H100/H200 que hoy dominan los data centers).

En plata: 35x menos costo por token comparado con Hopper. Y 1.5x menos costo por token que su antecesor GB200 para cargas de contexto largo, que es exactamente lo que usa un coding assistant o un agente de IA procesando documentos enteros.

CoreWeave ejecutó benchmarks sobre DeepSeek R1 y obtuvo 6.5x más throughput por GPU versus el H100 gracias a que el GB300 no necesita paralelismo tan agresivo: donde el H100 requería TP16 (tensor parallelism de 16 vías), el GB300 opera en TP4 porque tiene más memoria y más ancho de banda por chip.

Los precios del hardware: por qué importa

El DGX GB300 Station, la versión “escritorio” para empresas que quieren infra propia, arranca en aproximadamente $275,000 dólares por unidad según lo confirmado por los primeros compradores. Para el rack completo NVL72 el precio no está publicado oficialmente, pero basándose en el GB200 la estimación es alrededor de $5 millones de dólares por sistema.

Nadie en México va a comprar eso directamente. El impacto llega por otro lado: los hyperscalers.

Azure ya tiene operando el primer cluster a escala con más de 4,600 unidades GB300 NVL72, construido específicamente para los workloads de OpenAI. Google Cloud los está integrando a su plataforma A4X y A4X Max vía Dynamic Workload Scheduler. CoreWeave ya tiene instancias spot disponibles desde $2.90 dólares por hora.

Cuando los data centers reemplazan H100s con GB300s, el costo de servir tokens baja drásticamente. Y eventualmente ese ahorro llega a los precios de los APIs que usan las empresas.

Cuánto estás pagando hoy y qué puede cambiar

Hoy mismo, GPT-4o en Azure cuesta $2.50 por millón de tokens de entrada y $10 por millón de tokens de salida. Con el Batch API (para procesar en diferido) baja a $1.25/$5. GPT-4o Mini está en $0.15/$0.60 por millón de tokens.

Suena barato comparado con hace dos años, pero la realidad es que los costos de inferencia de LLMs han caído aproximadamente 1,000x en tres años: lo que corría el equivalente de GPT-4 costaba $20 por millón de tokens en 2022 y hoy está en $0.40 o menos dependiendo del proveedor.

El GB300 empuja esa tendencia más lejos. No esperes que los precios de Azure OpenAI bajen mañana, pero sí que durante 2026 Microsoft, Amazon y Google tienen más margen para bajar tarifas o introducir modelos más grandes al mismo precio porque su costo de hardware por token ya cayó.

Para una empresa mexicana que corre agentes de IA sobre bases de conocimiento de 100K+ tokens, esto se traduce en que el mismo presupuesto mensual va a dar para más llamadas o para usar modelos más potentes sin pagar más.

México: el contexto que nadie te dice

Según el reporte Clara 2026 citado por Fintech Expert, Mexico registró un crecimiento del 139% en inversión empresarial en IA, quedando como el segundo mercado más dinámico de LATAM detrás de Brasil. Y OpenAI domina con aproximadamente el 75% del market share corporativo, lo que significa que la gran mayoría de esas empresas está pagando tokens en Azure OpenAI o en la API directa de OpenAI.

La inferencia ya representa dos tercios de toda la demanda de cómputo de IA a nivel global, y se espera que llegue al 30-40% de la demanda total en centros de datos. México está en ese número: las empresas que adoptaron IA primero para experimentar ahora la usan en producción a escala, y el costo operativo ya no es chico.

Aquí es donde el GB300 conecta directamente con el bolsillo de las startups tech mexicanas, las agencias que venden soluciones de IA, y los equipos de ingeniería que integran LLMs en sus productos: si los costos de hardware bajan, los precios de los APIs bajan, y el margen de construir sobre ellos mejora.

Y si ya andabas pensando en reducir dependencia de la nube, nuestra guía de cómo correr tu propia IA local con Ollama y LM Studio sigue vigente como alternativa para workloads privados o donde no quieres pagar por token.

Lo que sigue: Vera Rubin ya está en el horizonte

Para que tengas contexto de la velocidad a la que va esto: el GB300 apenas lleva semanas entregándose a escala y Nvidia ya anunció Vera Rubin como la siguiente arquitectura. Como explicamos en nuestro análisis del Nvidia GTC 2026, Jensen Huang presentó Vera Rubin como el paso después de Blackwell Ultra, con salida planeada para la segunda mitad de 2026 (H2 2026). Vera Rubin Ultra está planeado para 2027.

Eso significa que la presión sobre precios de inferencia no para aquí. Cada generación que llega empuja el costo por token más abajo, y las empresas que empiecen a construir sobre APIs de LLMs ahora van a ver sus costos bajar mientras que su producto sigue igual o mejora.

No es que el GB300 sea relevante para ti como consumidor individual. Pero si trabajas en una empresa que gasta en IA, o si construyes productos sobre APIs de OpenAI, Anthropic o Google, este hardware es parte directa de la ecuación de por qué los próximos meses deberían ser más baratos.

La pregunta ya no es si va a bajar el costo de hacer IA en la nube. Ya está bajando. La pregunta es si tu empresa está bien posicionada para aprovechar ese margen cuando llegue.

¿Ya están calculando sus costos de tokens en producción o todavía están en modo experimental? Cuénten en los comentarios.

Fuentes

- NVIDIA: Blackwell Ultra Delivers up to 50x Better Performance and 35x Lower Costs for Agentic AI

- Microsoft Azure: First Large-Scale Cluster with NVIDIA GB300 NVL72 for OpenAI Workloads

- CoreWeave: GB300 NVL72 Production-Ready Instances con 6x Performance Gain en DeepSeek R1

- NVIDIA Newsroom: Blackwell Ultra AI Factory Platform

- Fintech Expert: México crece 139% en inversión empresarial en IA, reporte Clara 2026

- Expansion.mx: Inferencia será hasta 40% de demanda en centros de datos

- Azure OpenAI Service: Precios actuales 2026

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

NVIDIA Vera Rubin ya está aquí: el sucesor de Blackwell que promete bajar 10x el costo de la IA para empresas en México

NVIDIA presentó Vera Rubin en CES y GTC 2026: 50 petaflops por GPU, 10x menos costo por token que Blackwell, y llega a AWS, Azure y Google Cloud en el segundo semestre de 2026. Esto es lo que cambia para los negocios mexicanos.

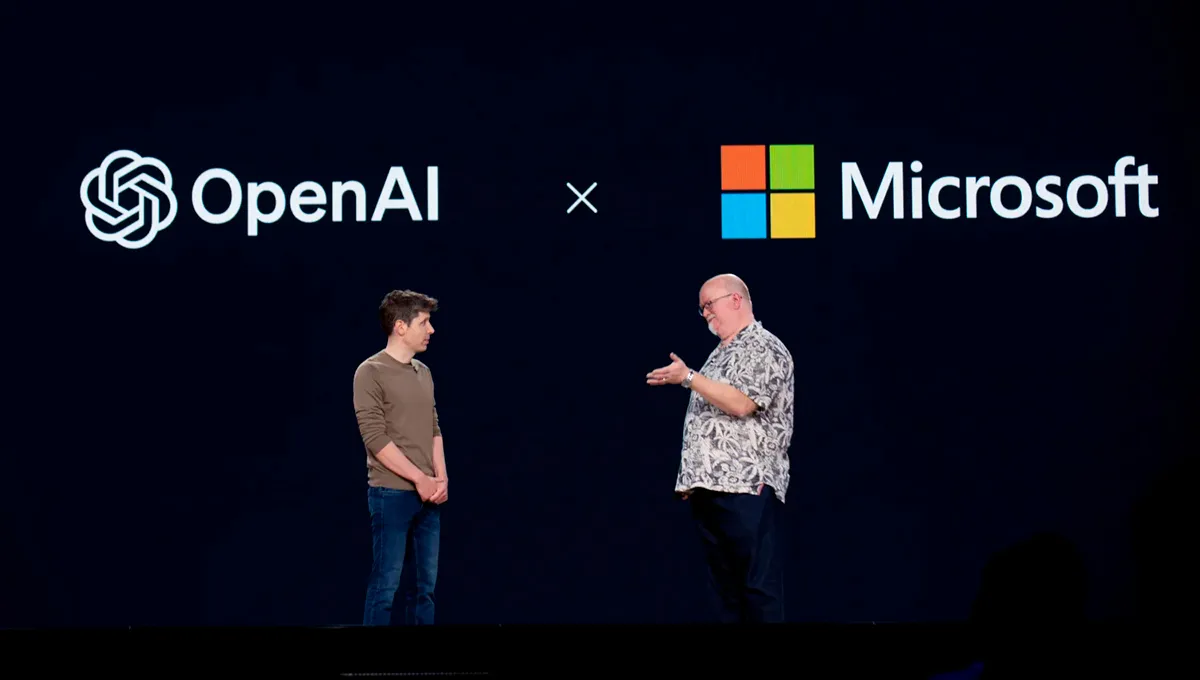

Microsoft va a demandar a OpenAI: el pleito de $50 mil millones que puede cambiar cómo usas la IA en tu empresa

Microsoft amenaza con llevar a OpenAI a los tribunales por un acuerdo de $50 mil millones con Amazon que supuestamente viola su exclusividad en Azure. Aquí está todo el pedo y qué significa para las empresas en México.

Un robot humanoide ya trabaja 8 horas seguidas en una fábrica de Siemens: qué significa esto para la manufactura en México

El HMND 01 con stack de NVIDIA completó turnos completos en Erlangen con 90% de éxito y 60 movimientos por hora. México tiene 9.7 millones de empleos manufactureros en la mira.