NVIDIA Vera Rubin ya está en producción: lo que cambia para México y las startups de IA en LATAM

NVIDIA confirmó en GTC 2026 que Vera Rubin está en producción total: 7 chips, 10x menos costo de inferencia y data centers en México preparados para recibirla en H2 2026. Esto es lo que significa para ti.

El 16 de marzo, en GTC 2026, Jensen Huang se paró en el escenario y soltó algo que la industria estaba esperando: Vera Rubin está en producción total. No es un anuncio de hoja de ruta, no es “viene pronto”. Está hecho. Y lo que esto significa para el costo de la IA en México y LATAM es bastante serio.

Qué es Vera Rubin y por qué importa ahora

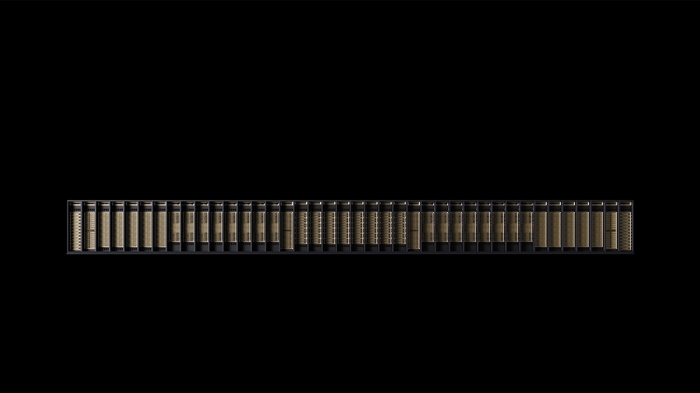

Vera Rubin no es solo una GPU nueva. Es una plataforma completa de 7 chips diseñados para trabajar juntos como un solo sistema. Los componentes son: la Vera CPU, la Rubin GPU, el NVLink 6 Switch, el ConnectX-9 SuperNIC, el BlueField-4 DPU, el Spectrum-6 Ethernet Switch, y el recién integrado Groq 3 LPU.

El buque insignia de todo esto es el rack NVL72: 72 GPUs Rubin y 36 CPUs Vera conectados con fabric NVLink 6, entregando 3.6 exaFLOPS de inferencia NVFP4. Para que tengas referencia: el NVLink 6 ofrece 3.6 TB/s de ancho de banda por GPU, y el rack completo mueve 260 TB/s, más que el ancho de banda de todo el internet combinado.

Los números de performance que NVIDIA presume contra Blackwell:

| Métrica | Mejora vs Blackwell |

|---|---|

| Costo de inferencia por token | 10x menor |

| GPUs necesarias para entrenar modelos MoE | 4x menos |

| Throughput de inferencia por vatio | 5x mayor |

| Tiempo de instalación del rack | De 2 días a 2 horas |

Ojo: el 10x aplica principalmente para inferencia con modelos MoE en secuencias largas. Para modelos densos en contextos cortos, el número realista es más cercano a 2x-3x. Pero incluso eso es enorme.

Lo que esto le hace al precio de la IA en la nube

Esta es la parte que le importa a cualquiera que pague por servicios de IA hoy. Los costos de inferencia ya venían cayendo en caída libre: de aproximadamente $20 por millón de tokens en 2022, a menos de $0.40 en 2026. Eso es una caída de 1,000x en tres años.

Con Rubin en producción y llegando a cloud providers en H2 2026, esa tendencia no frena. AWS, Google Cloud, Microsoft Azure y Oracle Cloud ya confirmaron que serán los primeros en desplegar instancias basadas en Vera Rubin, junto con socios como CoreWeave y Lambda.

Para una startup mexicana que hoy paga por tokens en OpenAI o Anthropic, esto se traduce directamente: más cómputo por el mismo presupuesto, o el mismo cómputo por menos lana. No de inmediato, pero el efecto ya empieza a sentirse en las cotizaciones de los cloud providers que están proyectando sus precios para fin de año.

Y como ya platicamos en el análisis de AMI Labs y la apuesta de Yann LeCun contra los LLMs actuales, la competencia en inferencia es brutal: modelos más baratos fuerzan a todos los proveedores a bajar precios o mejorar calidad.

México en el mapa: qué dijo NVIDIA

El 23 de marzo, Marcio Aguiar, director de Enterprise para NVIDIA Latin America, confirmó algo concreto: la arquitectura Rubin va a tener un lugar privilegiado en los data centers que se están preparando en México. La idea es que en 2026, México pase de ser un mercado de consumo de IA a convertirse en productor de capacidad computacional regional.

Aguiar habló de las industrias que van a adoptar esto primero: finanzas, manufactura, healthcare y retail. No es casualidad. Son los sectores que ya tienen los data centers y los contratos con proveedores cloud.

NVIDIA también anunció que va a capacitar a 2,000 profesionales en México antes de que termine el año. No es poca cosa si se considera que hay una escasez brutal de talento en MLOps e infraestructura de IA en el país.

Los data centers que van a actualizar primero

El ecosistema de infraestructura en México ya estaba moviéndose rápido antes de este anuncio. Estos son los jugadores que tienen más probabilidad de ser los primeros en recibir Rubin:

Equinix Querétaro: Comprometió $400 millones para agregar dos halls de 6 MW con liquid cooling de alta densidad. Exactamente el tipo de infraestructura que Rubin requiere.

KIO Networks: Están expandiendo a ciudades industriales y ya tienen certificación ICREA Level 6. Lanzaron su segundo hall en Querétaro (12 MW, Fase 1) en diciembre de 2024.

Los hyperscalers: AWS, Microsoft y Google tienen $6.3 mil millones comprometidos en conjunto para nuevas regiones e infraestructura cloud en México. Eso incluye las instancias Rubin cuando estén disponibles en H2 2026.

El mercado de data centers de IA en México está proyectado para crecer de $87 millones en 2026 a $261 millones para 2031, con un CAGR del 24.55%. México ya es líder regional en data centers y para 2029 podrían aportar el 5.2% del PIB, lo que pone al país en una posición bastante copada para sacar ventaja de este ciclo de inversión.

Qué significa para startups de IA mexicanas

Si estás construyendo un producto de IA hoy y pagas por cómputo, hay dos cosas que cambian con Rubin:

Lo bueno: más cómputo barato significa que puedes entrenar modelos más grandes o servir más inferencias con el mismo presupuesto. Si tu stack depende de APIs de terceros, vas a ver esos precios bajar a medida que los proveedores absorben el menor costo de hardware.

Lo complejo: las “AI Factories” que NVIDIA está vendiendo están diseñadas para empresas que consumen a escala. KIO, Equinix y los hyperscalers van a tener acceso a Rubin antes que cualquier startup. La barrera de entrada sube en el corto plazo antes de bajar.

El consejo práctico: si estás optimizando costos ahora, los modelos MoE como DeepSeek V3.1 ($0.15/M tokens) o Gemini Flash ($0.10/M tokens) ya son una opción viable. Rubin va a bajar aún más esos pisos en 12-18 meses. Como ya vimos en el reportaje sobre si la burbuja de la IA está a punto de tronar, la presión sobre los costos de cómputo es precisamente uno de los factores que está obligando a toda la industria a ser más eficiente.

El Groq 3 LPU: el detalle que nadie está explicando bien

Hay algo en este anuncio que pasó casi desapercibido: NVIDIA integró los procesadores Groq 3 LPU directamente en la plataforma Vera Rubin. Los racks Groq 3 LPX llevan 256 procesadores con 128 GB de SRAM cada uno y 640 TB/s de ancho de banda.

¿Por qué importa? Porque las GPUs no son el mejor hardware para todo tipo de inferencia. Para cargas de trabajo de IA agéntica, donde los modelos tienen que hacer razonamiento rápido y manejar contextos enormes, los LPUs de Groq son significativamente más eficientes. NVIDIA, en lugar de ignorar esto, simplemente lo compró e integró. Jensen Huang fue muy claro en GTC: “la inferencia no es un workload único”. El rack Rubin es modular por diseño.

Esto es relevante para México porque los casos de uso más prometedores en la región (automatización de manufactura, servicio al cliente, detección de fraude en finanzas) son exactamente el tipo de carga que se beneficia de los LPUs, no solo de GPUs.

Cuándo llega realmente

Timeline concreto:

- Ahora (Q1 2026): Vera Rubin en producción total en fábricas TSMC (proceso de 3nm)

- H2 2026: Disponibilidad para socios cloud (AWS, Google, Azure, OCI, CoreWeave)

- 2026-2027: Despliegue en data centers en México con KIO, Equinix y los hyperscalers

- 2027: Disponibilidad generalizada y reducción real de precios en servicios cloud de IA

Jensen Huang levantó la proyección de ingresos de NVIDIA de $500 mil millones a $1 trillón para 2027. Para que eso suceda, Vera Rubin tiene que estar desplegada masivamente. La motivación para que el timeline se cumpla es total.

Habrá que ver si los data centers en México pueden resolver el reto de sostenibilidad energética que viene con una demanda de electricidad tan masiva. El liquid cooling de Equinix en Querétaro apunta en la dirección correcta, pero es un tema que merece otro artículo.

¿Tú qué opinas? ¿México va a poder sacar ventaja de esta ventana de inversión o vamos a seguir siendo consumidores de infraestructura que otros construyen? Deja tu rollazo en los comentarios.

Fuentes

- NVIDIA Vera Rubin Opens Agentic AI Frontier - NVIDIA Newsroom

- GTC 2026: Nvidia Unveils Vera Rubin AI Platform, Eyes $1T by 2027 - Data Center Knowledge

- México en la élite tecnológica: NVIDIA traerá su arquitectura “Rubin” al país - Cadena Política

- Mexico Artificial Intelligence AI Data Center Market - Mordor Intelligence

- Nvidia launches Vera Rubin NVL72 AI supercomputer at CES - Tom’s Hardware

- México ya es líder regional en data centers - Expansión

Comentarios

No te pierdas ningún post

Recibe lo nuevo de Al Chile Tech directo en tu correo. Sin spam.

También te puede interesar

Microsoft mete $10 mil millones en Japón para IA y México sigue esperando: qué necesita el país para estar en ese mapa

Mientras Brad Smith firmaba un cheque de $10B en Tokio, México pelea con la CFE, el agua y la regulación para no quedarse fuera de la carrera global por la infraestructura de IA.

El chip de IA que China construyó para no necesitar a NVIDIA: Huawei Ascend 950PR ya tiene pedidos de ByteDance y Alibaba

ByteDance y Alibaba van por 750,000 unidades del Huawei Ascend 950PR en 2026. A $6,900 dólares por tarjeta y con soporte para migrar código CUDA, China acaba de cambiar las reglas del cómputo de IA.

Google abre su primer laboratorio de IA en México: qué significa de verdad para devs, startups y empresas

Google instaló su primer AI Lab en San José Chiapa, Puebla, dentro de Ciudad Modelo. Aquí te explico qué cambia para los desarrolladores mexicanos, si el hype es real, y cómo le va a México frente a Brasil en la carrera de IA de LATAM.